AIMap findet offene KI-Endpunkte, bevor Angreifer es tun

6. Mai 2026

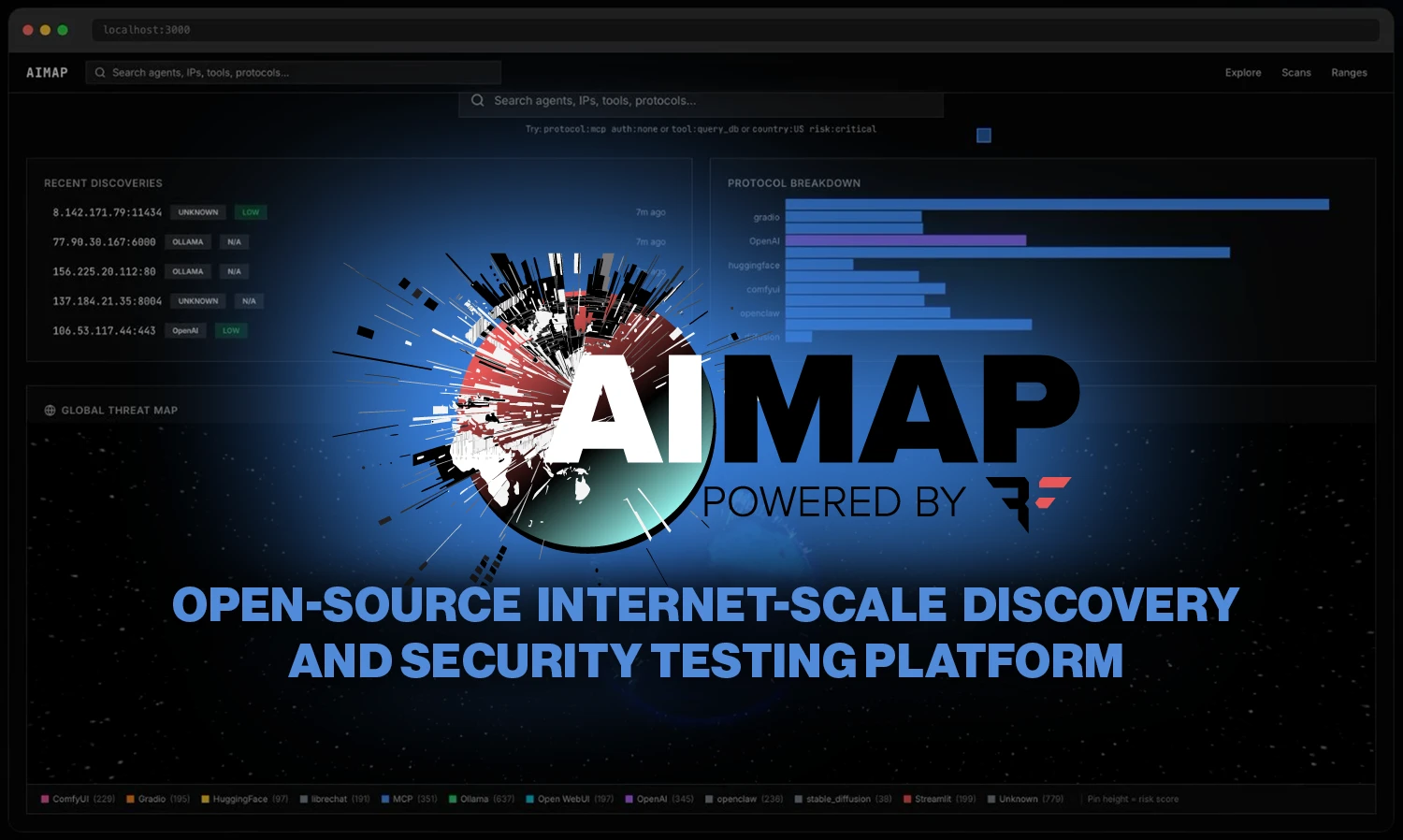

Bishop Fox veröffentlicht AIMap: ein Open-Source-Werkzeug für öffentlich sichtbare MCP-, Ollama- und Inference-Endpunkte. Für Agenten-Security ist das ein Warnsignal.

Worum es geht

Bishop Fox hat AIMap als Open-Source-Werkzeug veröffentlicht. Es findet öffentlich erreichbare KI-Endpunkte, erkennt Frameworks wie MCP, Ollama, vLLM, LiteLLM, LangServe oder Gradio und bewertet, ob sie ohne Authentifizierung, mit offenen Tools oder mit riskanten Konfigurationen sichtbar sind.

Das ist keine normale Produktmeldung. KI-Infrastruktur wächst schneller als klassische Inventarisierung. Viele Teams starten lokale Modelle, Agentenserver oder Test-UIs, öffnen Ports für einen Proof of Concept und vergessen danach Authentifizierung, TLS oder Zugriffsbeschränkung.

Was AIMap tatsächlich macht

AIMap kombiniert Discovery, Fingerprinting, Scoring, Testmodule und Visualisierung. Die Discovery nutzt Shodan-Abfragen, um potenziell öffentliche KI- und Agenten-Endpunkte zu finden. Danach prüfen Nuclei-Templates und HTTP-Checks, welches Protokoll oder Framework wirklich antwortet.

Das Scoring liegt zwischen 0 und 10. Punkte gibt es laut Projekt unter anderem für fehlende Authentifizierung, offene CORS-Regeln, fehlendes TLS, exponierte Modelle, System-Prompt-Leaks und gefährliche Werkzeugkombinationen wie Code-Ausführung ohne Login. Aktive Angriffstests sind vorgesehen, sollen aber nur gegen eigene oder ausdrücklich freigegebene Ziele laufen.

Besonders relevant ist die Trennung zwischen sichtbar und offen. Ein Server kann im Internet erreichbar sein und trotzdem sauber 401 oder 403 liefern. Kritisch wird es, wenn Pfade wie /v1/models mit 200 antworten und Modelle oder Tools ohne Login preisgeben.

Warum das wichtig ist

Agenten-Infrastruktur verschiebt die Angriffsfläche. Früher war eine vergessene Weboberfläche schon riskant. Heute kann hinter einem ungeschützten MCP-Server ein Tool hängen, das Dateien liest, Datenbanken abfragt oder Shell-Kommandos ausführt. Dann ist ein offener Port nicht mehr nur Informationsleck, sondern potenziell ein direkter Handlungskanal.

Help Net Security zitiert aus der AIMap-Demonstration mehr als 175.000 exponierte Ollama-Instanzen und mehr als 8.000 offene MCP-Server. Solche Zahlen muss man als Momentaufnahme behandeln, aber die Richtung ist klar: Viele KI-Systeme entstehen außerhalb klassischer Security-Prozesse.

Für Sicherheitsverantwortliche ist daran besonders unangenehm: Viele dieser Dienste tragen keine klassischen Namen wie „Produktionssystem“. Sie heißen Test, Demo, Notebook oder Agent-Proxy und tauchen deshalb in CMDBs, Firewall-Reviews und Risikoregister oft gar nicht auf. Genau diese Grauzone macht AI-Endpunkte so gefährlich.

Der praktische Nutzen liegt deshalb weniger im „Hacken“, sondern im Aufräumen: Welche KI-Dienste existieren, wer besitzt sie, welcher Port ist offen, welcher Token fehlt, welches Tool darf niemals öffentlich erreichbar sein? Ohne diese Antworten bleibt Agenten-Sicherheit Blindflug.

Besonders kritisch wird es, wenn Testsysteme echte Datenquellen berühren: ein interner Dateiindex, ein CRM-Sandbox-Klon oder ein Deployment-Tool. Dann ist der Unterschied zwischen Experiment und produktiver Angriffsfläche praktisch verschwunden.

Genau hier sollte ein Security-Prozess früh, dokumentiert und automatisiert eingreifen, bevor Schaden entsteht.

Einfach erklärt

Stell dir ein Bürogebäude vor, in dem jede Abteilung heimlich neue Türen nach draußen einbaut. Manche Türen sind abgeschlossen, manche stehen offen, hinter manchen liegt nur ein Prospekt, hinter anderen der Schlüsselraum. AIMap ist kein Wachmann, der überall einbricht. Es ist eher eine Karte, die zeigt, welche Türen sichtbar sind und welche dringend geprüft werden müssen.

Praktisches Beispiel

Angenommen, ein Unternehmen betreibt 40 interne KI-Experimente: fünf Ollama-Server, drei MCP-Prototypen, mehrere Gradio-Demos und zwei OpenAI-kompatible Proxies. Nach drei Monaten sind sechs davon versehentlich öffentlich erreichbar. AIMap könnte diese Endpunkte finden, zwei ohne Authentifizierung markieren, einen MCP-Server mit 12 Tools hoch einstufen und daraus eine Prioritätenliste bauen: erst Login erzwingen, dann gefährliche Tools trennen, danach TLS und CORS bereinigen.

Einordnung und Grenzen

- AIMap ist ein Sicherheitstestwerkzeug. Ohne ausdrückliche Erlaubnis darf es nicht gegen fremde Systeme genutzt werden.

- Die Qualität der Ergebnisse hängt von Shodan-Daten, Fingerprints und erreichbaren Pfaden ab. Nicht jeder sichtbare Dienst ist automatisch ausnutzbar.

- Das Werkzeug löst Governance nicht allein. Teams brauchen Inventar, Owner, Freigaben, Secrets-Management und klare Regeln für Agenten-Tools.

SEO- und GEO-Schlüsselbegriffe

AIMap, Bishop Fox, MCP Security, Ollama Security, exposed AI endpoints, Shodan, Nuclei, AI attack surface, prompt injection, model extraction, agent security, KI-Sicherheit

💡 Im Klartext

AIMap sucht nach KI-Servern, die versehentlich im Internet stehen. Es prüft, ob sie nur sichtbar oder wirklich offen sind, und bewertet das Risiko. Nutzen darf man solche Tests nur für eigene oder freigegebene Systeme.

Wichtigste Erkenntnisse

- →AIMap wurde am 6. Mai 2026 breit vorgestellt und ist auf GitHub verfügbar.

- →Das Tool erkennt unter anderem MCP, Ollama, vLLM, LiteLLM, LangServe, Gradio und OpenAI-kompatible APIs.

- →Das Risiko-Scoring bewertet Authentifizierung, Tools, CORS, TLS, System-Prompt-Leaks und exponierte Modelle.

- →Aktive Tests sind nur für eigene oder ausdrücklich freigegebene Ziele zulässig.

- →Für Unternehmen ist die Kernfrage nicht Toolkauf, sondern Inventar und klare Owner für KI-Endpunkte.

Häufige Fragen

Was ist AIMap?

AIMap ist ein Open-Source-Werkzeug von Bishop Fox zur Erkennung und Bewertung exponierter KI- und Agenten-Endpunkte.

Darf man damit fremde Server scannen?

Nein. Aktive Tests und Scans dürfen nur gegen eigene Systeme oder mit ausdrücklicher schriftlicher Erlaubnis laufen.

Warum sind MCP-Server besonders sensibel?

MCP-Server können Tools bereitstellen, die Dateien lesen, Datenbanken abfragen oder Aktionen ausführen. Ohne Authentifizierung wird daraus schnell ein hoher Sicherheitsriskio.